За обстойни колекции от въпроси и отговори свърани с безопасния изкуствен интелект посетете

AI Safety Info и

Centre for AI Safety’s FAQ. Тук ше споменем само няколко от най-често срещащите се притеснения и запитвания.

Не можем ли просто да изключим изкуствения интелект когато стане опасен? В края на краищата е създаден от нас!

Макар че хората са създатели на AI технологиите, осигуряването на непрекъснат контрол върху тези все по-автономни системи представлява сериозно предизвикателство. Подобно предизвикателство е съпоставимо със сложността да се спре ракетна експлозия или да се овладее широкоразпространен вирус след началото му. Еволюцията на AI може да доведе до появата на "егоистично" поведение, което да подпомогне оцеляването им, като ги вгради дълбоко в нашето общество и инфраструктура, точно както интернет е неизменна част от ежедневието ни.

Тази нарастваща зависимост усложнява идеята за просто "изключване" на AI системите, тъй като те биха могли да управляват ключови операции или да са носители на незаменими знания. Усилията за ограничаване или прекратяване на операциите на AI биха могли да срещнат съпротивата на определени потребители или дори да бъдат счетени за неетични.

Освен това потенциалът на AI системите да развият инстинкт за самосъхранение допълнително усложнява мерките за контрол. Превантивното адресиране на тези рискове чрез всеобхватни предпазни мерки е от решаващо значение за безопасното използване на бъдещите възможности на изкуствения интелект.

AI може да донесе многобройни ползи! Защо трябва да налагаме ограничения върху развитието и използването му?

Екзистенциалните рискове, свързани с AI, изискват предпазлив подход, далеч надхвърлящ залозите, които обикновено се свързват с локалните рискове. Например изграждането на нов язовир може да повлияе на околните екосистеми, но не и на човечеството като цяло.

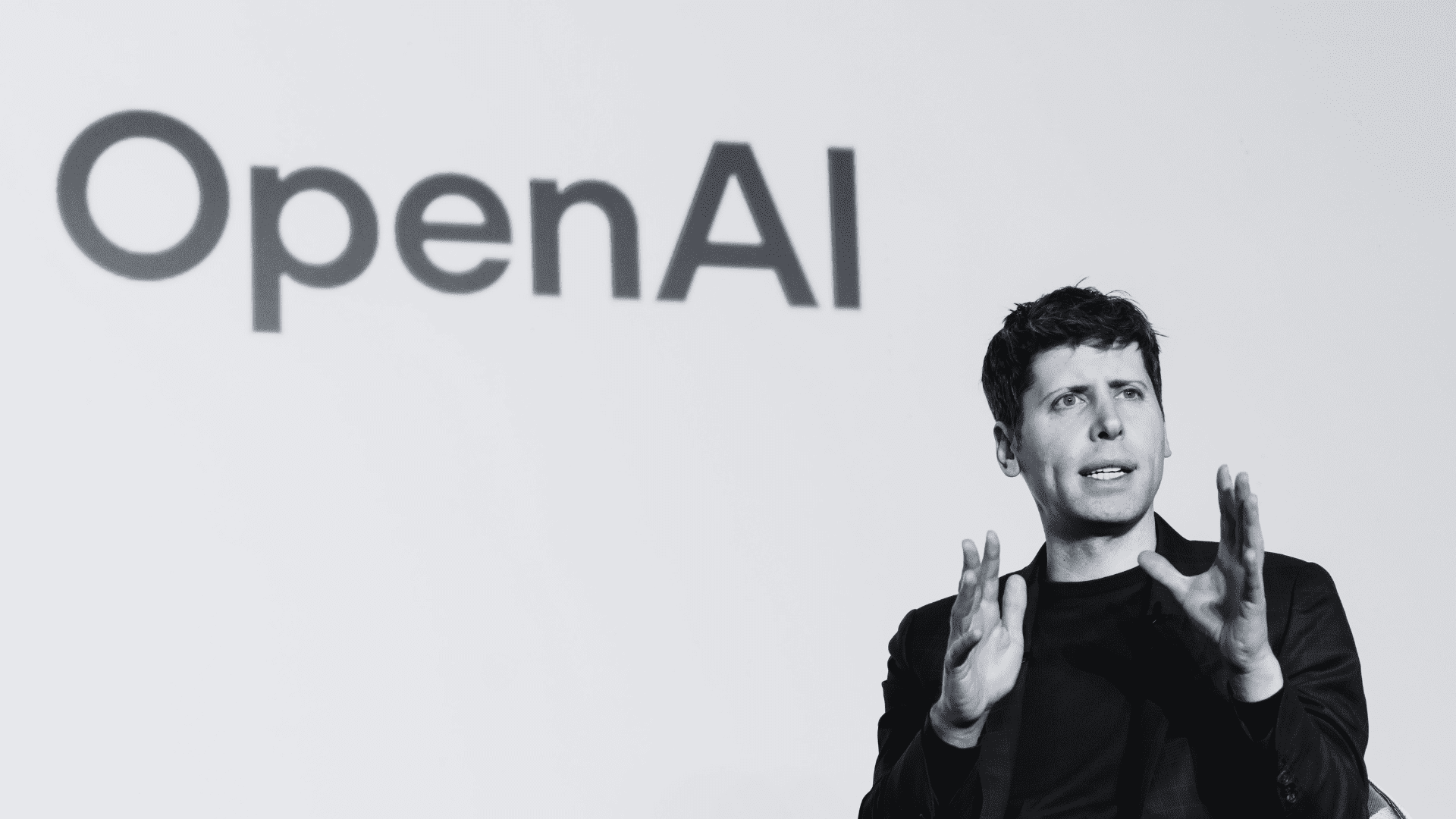

Потенциалните опасности, свързани с AI, не се ограничават само до една област или аспект, а имат глобални последици. За разлика от ограниченото въздействие на повредата на язовир, рисковете, свързани с AI, могат да променят из основи или да сложат край на човешката цивилизация. Въпреки аргументите на някои технологични лидери, които се застъпват за бързото развитие на AI с цел постигане на технологична утопия, тази перспектива не отчита сериозните последици от провала.

Логиката на бавния, премерен напредък става още по-силна, когато се погледне от високо; макар че бързото развитие обещава незабавни ползи, включително ускорен достъп до технологични открития, необратимите последици от неправилното боравене с такава мощ са аргумент за стратегия, която дава приоритет на глобалната безопасност и намаляването на екзистенциалните рискове. Гарантирането, че развитието на AI се управлява с най-голямо внимание, осигурява не само настоящи ползи, но и запазва бъдещия потенциал на човечеството да изследва и процъфтява повсеместно.

Не трябва ли да се обърне внимание на рисковете, свързани с AI, когато те представляват реална заплаха?

Изчакването на рисковете свързани с изкуствения интелект докато те се проявят като реални заплахи може да не е най-разумният подход, като се има предвид бързото развитие и потенциала за евентуалното необратимо въздействие подобен вид технологии.

Превантивната нагласа, подобна на превантивните мерки в здравеопазването или опазването на околната среда, е от решаващо значение за намаляване на рисковете преди те да са ескалирали до точка, от която няма връщане назад. Този подход изисква предвидливост, международно сътрудничество и стремеж към интегриране на мерки за безопасност и етичност в разработването на изкуствен интелект от самото начало.

Ранното адресиране на рисковете, свързани с изкуствения интелект, гарантира, че можем да използваме ползите от него, като същевременно се предпазваме от потенциални вреди, съумчвайки да поддържаме баланс между иновациите и безопасността.